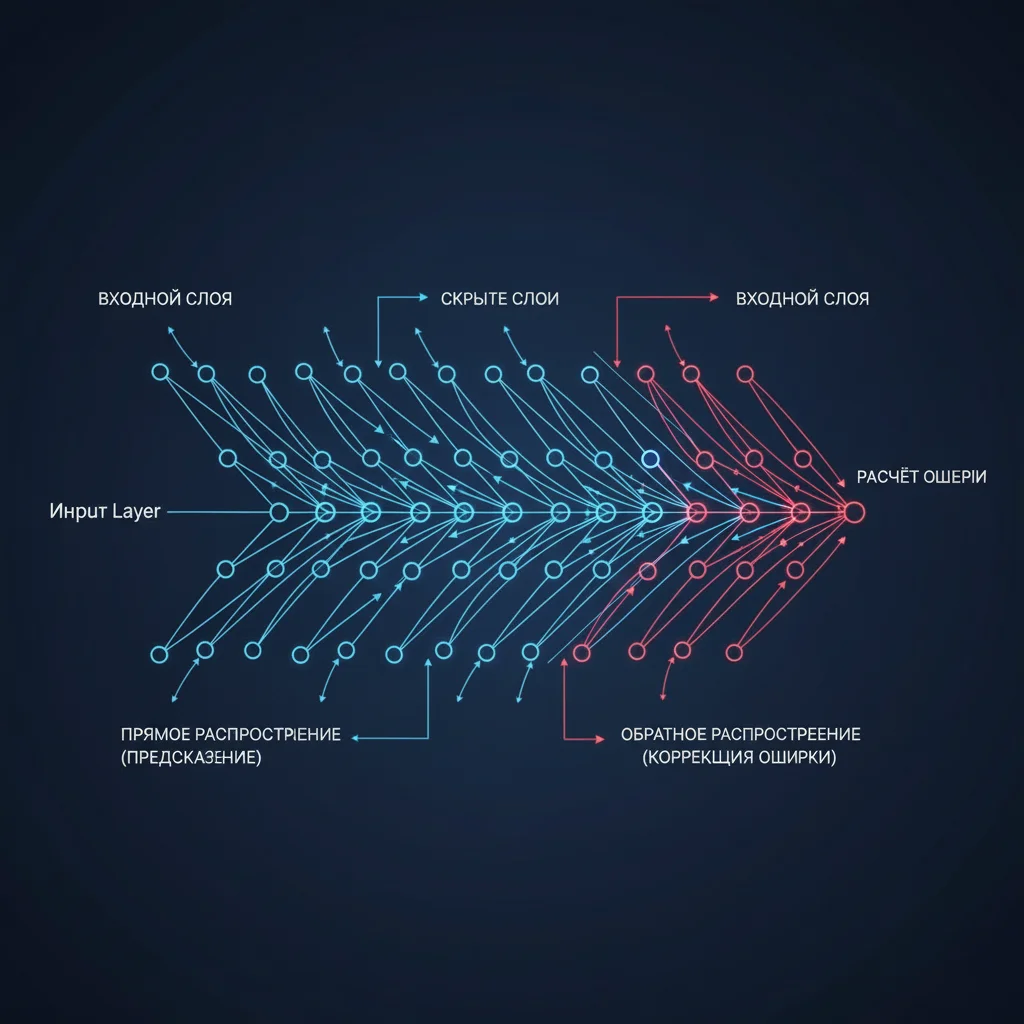

Обратное распространение ошибки (backpropagation) — это алгоритм, который позволяет нейросети учиться, корректируя свои внутренние параметры на основе ошибок.

Как это работает по шагам:

Прямой проход (forward pass)

Сеть получает входные данные (например, фото кота) и выдаёт предсказание («собака»).Вычисление ошибки

Сравнивается предсказание с правильным ответом. Ошибка измеряется функцией потерь (например, кросс-энтропия).Обратный проход (backward pass)

Ошибка «распространяется» назад через сеть. Алгоритм вычисляет, насколько каждый вес в каждом нейроне повлиял на итоговую ошибку.Коррекция весов

С помощью градиентного спуска веса немного изменяются в сторону, которая уменьшает ошибку.

Почему это важно:

- Без обратного распространения нейросеть не могла бы обучаться на больших данных,

- Оно позволяет корректировать миллионы параметров одновременно,

- Это делает обучение автоматическим и масштабируемым.

Важно понимать: сеть не «понимает», что она ошиблась. Она просто математически минимизирует разницу между своим ответом и правильным.

Таким образом, обратное распространение — это механизм самонастройки, превращающий случайные предсказания в точные за тысячи итераций. Это и есть суть машинного обучения.